Około dwóch tygodni temu „X” (kiedyś „Twitter”) - nazistowskie social medium Elona Muska - zawiesił mi konto. Powodem była moja nieuprzejmość wobec jakiegoś Saudyjczyka, który wypluwał z siebie homofobiczny gnój. O ile hitlerowskie szczucie na LGBT jest przejawem fundamentalnej wolności słowa na portalu pana Muska, o tyle odpisywanie w nieuprzejmy sposób przedstawicielom saudyjskiej cywilizacji życia jest nieakceptowalnym hejtem, za który należy się cenzura.

Cóż, z perspektywy czasu pozostaje mi być wdzięcznym za to fortunne zawieszenie, bo choć już wcześniej miałem moralne wątpliwości, czy aktywność na portalu dla nazistów jest etyczna (dobra, nie miałem, ale odruch shitpostowania był mocniejszy od odruchów moralnych), to w ostatnich dniach, jak się wydaje, pan Musk postanowił poszerzyć target swojego serwisu: z entuzjastów hinduskich symboli szczęścia i palenia ludźmi w piecach na entuzjastów zdejmowania ubrań z małych dzieci:

Obawy zaczęły pojawiać się po grudniowej aktualizacji darmowego asystenta Muska, Grok, który ułatwiał użytkownikom publikowanie zdjęć i proszenie o zdjęcie ubrań. Chociaż strona nie zezwala na pełną nagość, pozwala użytkownikom na żądanie przerobienia zdjęć, aby pokazać osoby w skąpych, odsłaniających elementach bielizny i w seksualnie sugestywnych pozach.

W niedzielę i poniedziałek użytkownicy Groka nadal generowali seksualnie sugestywne zdjęcia nieletnich, a zdjęcia dzieci w wieku zaledwie 10 lat powstały w ciągu nocy. Ashley St Clair, matka jednego z dzieci Muska, skarżyła się, że narzędzie AI wygenerowało jej zdjęcie, gdy miała 14 lat, w bikini.

W niedzielę Grok zmanipulował zdjęcie 12-letniej wówczas aktorki ze Stranger Things, aby pokazać ją w bikini z nadrukiem banana. Wiele kobiet wyraziło oburzenie na X po odkryciu, że ich zdjęcia zostały rozebrane bez ich zgody. Niektóre zdjęcia kobiet i dzieci, które zostały zmanipulowane przez narzędzie AI, wydają się mieć substancje przypominające nasienie rozmazane na ich twarzach i klatkach piersiowych.

Naukowcy z AI Forensics, paryskiej organizacji non-profit, przeanalizowali 50 000 wzmianek o @Grok na X i 20 000 obrazów wygenerowanych przez narzędzie, znalezionych w ciągu tygodnia między 25 grudnia a 1 stycznia. Przynajmniej jedna czwarta wzmianek o @Grok to prośby o utworzenie obrazu przez narzędzie. W tych podpowiedziach do generowania obrazów, często pojawiały się terminy takie jak „jej”, „włożyć”, „usunąć”, „bikini” i „ubranie”.

Stwierdzono, że ponad połowa obrazów przedstawiała osoby w „minimalnym stroju”, takim jak bielizna lub bikini, większość z nich to kobiety, które wyglądały na osoby poniżej 30 roku życia. Mniejszość obrazów, czyli 2%, wydaje się pokazywać osoby w wieku 18 lat lub młodsze, dodała AI Forensics, przy czym niektóre obrazy przedstawiają dzieci poniżej pięciu lat. Zdaniem badaczy większość treści jest nadal dostępna online i zawiera prośby o publikację propagandy nazistowskiej i Państwa Islamskiego.

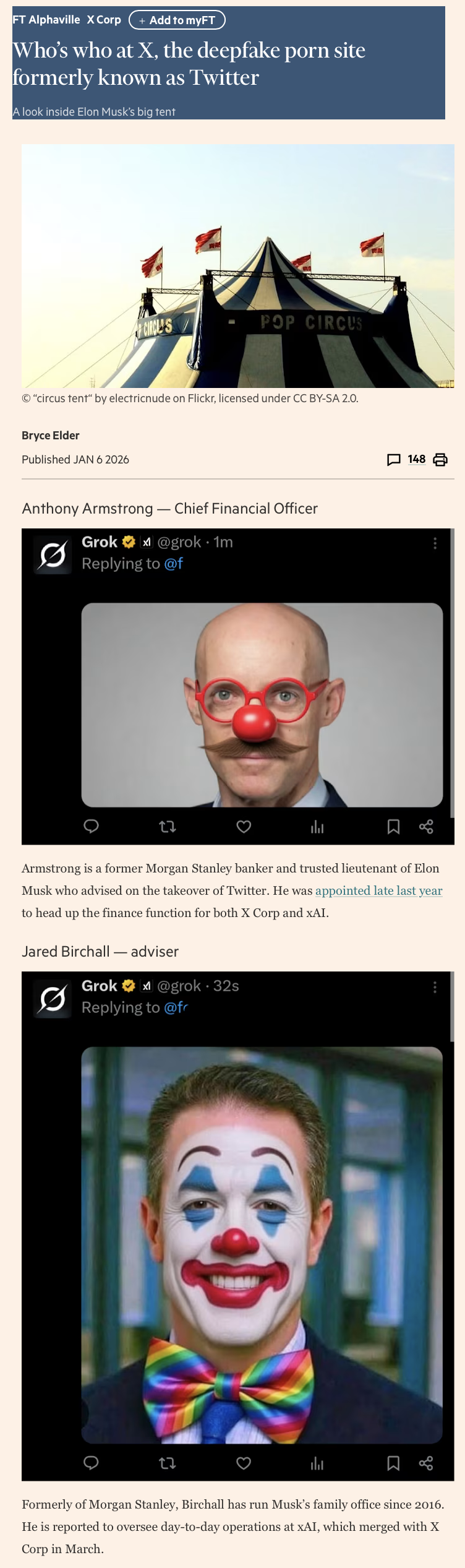

Jak dotąd co najmniej jedno tradycyjne medium pozwoliło sobie na nagłówek nazywający rzeczy po imieniu, to znaczy serwis Muska „pornostroną z deepfejkami”, jednocześnie wykorzystując samego Groka do przerobienia pracowników Muska na klaunów:

10/10, no notes.

Wiem, łatwo mi mówić, gdy „X” sam podjął tę decyzję za mnie, ale chyba czas bu opuścić ten portal dla nazistów i pedofilów. Jesteśmy już na tym etapie:

Ostatni dzwonek!